INTRODUCCIÓN

Robert Lucas sugirió en su teoría sobre las expectativas racionales rational expectations que las decisiones de los agentes económicos se basan en la interpretación de la información histórica, presente y futura que reproduce el mercado. Según la hipótesis de los mercados eficientes Efficient-market hypothesis, desarrollada por Eugene Fama, en un contexto de competencia perfecta e irrestricta movilidad de capitales, los precios de los activos financieros sintetizan la información relevante del mercado y constituyen el principal insumo para la toma de dichas decisiones. Externalidades tales como noticias inesperadas, guerras o sucesos particulares inciden en la determinación de los precios de forma estocástica, es decir, bajo un ambiente de incertidumbre, lo que fue estudiado por Robert Hall en la teoría del paseo aleatorio (Random Walks).

La inestabilidad de la inflación, las tasas de cambio, los precios de las acciones, bonos de deuda, commodities, entre otros, ha constituido uno de los factores de mayor atención en la teoría económica, toda vez que la volatilidad experimentada por estas variables dificulta la planeación financiera y en consecuencia, compromete un mayor nivel de riesgo en la toma de decisiones. Los modelos de volatilidad acumulada constituyen un esfuerzo de la econometría financiera por cuantificar el impacto de aquello que produce inestabilidad en la definición del precio de un activo financiero, facilitando por supuesto, el análisis de opciones tanto de consumo como de inversión.

El principal propósito de este artículo estriba en presentar al lector una serie de conceptos introductorios sobre el manejo de series de tiempo financieras caracterizadas por el fenómeno de la acumulación en riesgo o volatilidad acumulada, al tiempo que se pretende establecer su interpretación y significancia a partir de externalidades históricas como el atentado terrorista del 11 de septiembre, la caída de Lehman brothers y las recientes decisiones proferidas por la FED mediante el quantitative easing y el tapering. Para su aplicación se han considerado un total de 3488 observaciones pertenecientes a tres importantes indicadores del mercado bursátil norteamericano: Nasdaq, Dow Jones Industrial y S&P 500 que corresponden al periodo comprendido entre febrero 24 de 2000 y febrero 17 de 2014.

EL PANORAMA ACTUAL: QUANTITATIVE EASING QE3 Y TAPERING

La información reciente sugiere que la economía norteamericana se recupera de manera paulatina; no obstante que el ciclo económico mundial se ha previsto del 2,9% en 2013 y 3,6% en 2014 (BBVA; 2013b: 3). En el último trimestre de 2013 el S&P 500, el Dow Jones y el Nasdaq habrían experimentado valorizaciones del 9,9%, 9,6% y 10,7% respectivamente; mientras que el crecimiento económico agregado del tercer trimestre se habría ubicado en el 2,8% (Banco de la República, 2014b: 55). En mayo de 2013 la Reserva Federal de los Estados Unidos anunció lareducción gradual de las compras de bonos y títulos hipotecarios en un monto de US$ 10.000 millones mensuales, considerando entonces un plan monetario de US$ 75.000 millones mensuales a partir de enero de 2014 que, habían sido efectuados mediante un esquema de emisión de originalmente US$ 40.000 millones mensuales y cuyo ascenso llegó incluso a los US$ 85.000 millones mensuales desde diciembre de 2012 bajo el denominado Programa de relajamiento cuantitativo “Quantitative Easing QE3” cuya tarea prioritaria descansaba en disminuir los tipos de interés e impulsar los créditos de consumo e inversión para estimular la demanda agregada, la producción y el mercado laboral.

Naturalmente, el anuncio contraccionista de la FED conocido como “Tapering” produjo nerviosismo y volatilidad en los mercados financieros del mundo; el desmonte del programa se suscitó el pasado 18 de diciembre de 2013, no sin antes considerar el compromiso de mantener un rango de tipos de interés entre el 0% y 0,25% (Toro, 2014). El efecto inmediato del anuncio provocó el incremento de los tipos de interés de largo plazo, particularmente los correspondientes a los títulos de deuda pública a 10 años que pasaron del 1,7% en mayo de 2013 al 3% en septiembre del mismo año (BBVA, 2013b) y cuyo comportamiento ha venido revirtiéndose a partir de los esfuerzos de la FED por hacer comprensible la gradualidad del desmonte del programa y su compatibilidad con las metas de crecimiento de la producción, el control de la inflación y la generación de empleo.

MODELOS AUTO-REGRESIVOS CONDICIONADOS POR HETEROCEDASTICIDAD:

Algunas justificaciones teórico-prácticas

Las acciones, los bonos de deuda pública, las materias primas internacionales, las tasas de cambio, los índices bursátiles, la inflación, entre otras variables financieras se caracterizan porque sus series de tiempo están acompañadas por el fenómeno de la volatilidad. La volatilidad puede definirse como el cambio de frecuencia e intensidad asociada al precio de un determinado activo financiero o sus rendimientos derivados dentro del mercado dada la llegada de nueva información.

Expuesto de otra forma, las decisiones de los agentes económicos se basan en la información disponible y la formación de expectativas sobre los rendimientos futuros y el riesgo asociado a las alternativas de inversión, factores que, en condiciones de estabilidad, posibilitan predicciones cuyos valores convergen potencialmente hacia su media aritmética o valor medio esperado. Sin embargo, la presencia de nueva información, la reconfiguración de expectativas y las decisiones que de lo anterior se derivan, introduce en efecto, una mayor volatilidad financiera capaz de modificar el comportamiento tradicional de los precios y los rendimientos esperados y efectivos.

En palabras de Engle: Por lo tanto, a un nivel muy básico, podemos afirmar que la volatilidad de los precios financieros se debe a la llegada de nueva información. El agrupamiento de la volatilidad corresponde simplemente al agrupamiento de la llegada de información. El hecho de que ésta sea común para tantos activos simplemente refleja el hecho de que la llegada de información nueva está generalmente agrupada en el tiempo (Engle 2003: 330).

Ahora bien, la presencia de nueva información que el mercado haya considerado excepcional, tal como un descubrimiento científico, una intempestiva declaración de guerra, una crisis económica, fenómenos que en todo caso, puedan considerarse como impredecibles, dificulta la valoración de los activos financieros y la determinación del precio, introduciendo deliberadamente un nuevo factor de volatilidad que tiende a agruparse en el tiempo a partir de ciclos intertemporales.

El incremento de la volatilidad de una inversión se traduce en una mayor exposición al riesgo y en consecuencia, en una exigencia paralela del mercado para que los activos amplifiquen los retornos esperados de tal forma que garanticen a los tenedores la compensación equivalente por mantener “intactas” sus posiciones en el nuevo escenario que les asiste. Si bien la teoría ha modelado una relación positiva entre el rendimiento y el riesgo de los activos financieros, la evidencia empírica frente a externalidades que exacerban la volatilidad media y ejercen recompensas en los retornos no es del todo concluyente (Engle 2003: 332).

Bajo ese espectro de análisis existen dos posiciones diferentes sobre la relación existente entre rentabilidad y riesgo. La primera fundamentada sobre los avances de la moderna teoría de portafolios propuesta por Markowitz modern portfolio theory y el modelo de valoración de activos financieros the capital asset pricing model desarrollado por Sharpe. La idea central subyace en que un inversionista asumiría un mayor nivel de riesgo si el activo financiero incrementa de forma atractiva su rendimiento esperado. Markowitz advierte sin embargo: Los conceptos de ‘rentabilidad’ y ‘riesgo’ frecuentemente se exhiben en los textos económicos. Pero si el término ‘rendimiento’ se sustituyera por ‘rendimiento esperado’ o ‘retorno esperado’ y el de ‘riesgo’ por ‘variación de retorno’ este aparente pequeño cambio a la realidad podría afectar el resultado de dichas decisiones (Markowitz, Harry. 1952: 89)2.

En segundo término, Bowman plantea que las empresas caracterizadas por un menor nivel de riesgo generan la confianza y las asignaciones de recursos que les posibilita la obtención de altos niveles de rentabilidad, su teoría se basa en aplicaciones de teoría de juegos ajustada a los indicadores contables y las tesis administrativas de la prospección. En sus propias palabras la paradoja de Bowman “the bowman paradox” establece que: La explicación de una correlación negativa entre el riesgo y la rentabilidad puede justificarse dentro de una industria, como el resultado de la buena gestión que trae consigo un mayor rendimiento y que implica más confianza. Una ilustración alternativa, que sin embargo, parece menos plausible, reside en que los gerentes que advierten un menor nivel de rentabilidad pueden ser proclives a enfrentar una mayor exposición al riesgo, lo que es contrario a la teoría convencional. Una revisión al pensamiento económico para clarificar esta inquietud sugiere la vuelta a Adam Smith (Bowman, Eduard. 1980: 18).

Buena parte de los esfuerzos recientes en finanzas se han centrado en explicar la presencia de la volatilidad y sus efectos en las decisiones de los agentes; con ese objetivo en mente, la teoría económica y financiera, junto con los progresos recientes en estadística y econometría impulsaron el denominado “caballo de batalla” (workhorse) para hacerle frente al desafío que entraña el concepto y sus posiciones teóricas subsecuentes, el resultado ha devenido en el Modelo Autorregresivo Condicionado por Heterocedasticidad “Autoregressive conditional Heteroskedasticity Model” ARCH de Robert Engle que le valió la adjudicación del premio Nobel de Economía en 2003.

El propio Engle sostiene que determinar las causas de la volatilidad sigue siendo un reto de la economía y las finanzas; los modelos ARCH sin embargo, se aproximan a su predicción, lo que posibilita que, los agentes económicos involucrados en la toma de decisiones de inversión consideren ahora, dentro de la formación de sus expectativas de rentabilidad, el comportamiento esperado de la volatilidad que entraña el papel del riesgo. Las causas de la volatilidad se modelan de forma más directa. Dado que el modelo ARCH básico y sus numerosas variantes describen la varianza condicionada como una función de los retardos del cuadrado de los rendimientos, éstas son probablemente las causas más cercanas de la volatilidad. Pero es mejor interpretarlos como observables que ayudan a predecir la volatilidad y no como causas. Si las verdaderas causas se incluyesen en la especificación, entonces no se necesitarían los retardos ( Engle, 2003: 229).

Siguiendo a Gujarati (Gujarati y Porter, 2010: 792-793) la volatilidad puede expresarse como:

Donde,

x

t

se define como una medida de volatilidad, y

t

es el precio del activo financiero y n representa el número de observaciones. El factor

constituye una primera diferencia derivada de los logaritmos naturales de los precios, mientras que el componente

constituye una primera diferencia derivada de los logaritmos naturales de los precios, mientras que el componente

constituye un promedio aritmético de las primeras diferencias que una vez calculado se reduce a una constante que permite el convencional ajuste en la obtención de una varianza estadística.

constituye un promedio aritmético de las primeras diferencias que una vez calculado se reduce a una constante que permite el convencional ajuste en la obtención de una varianza estadística.

Gujarati sugiere de forma introductoria que un esquema ARCH puede resumirse así:

Este arquetipo simplemente contempla el hecho de que la volatilidad de los activos financieros en un periodo t puede explicarse por la volatilidad de un periodo anterior (t-1); lo que se conoce como un modelo ARCH(1) y que puede ser extendido a p órdenes para constituir un patrón ARCH(p).

El orden p puede ser determinado por el investigador con base en los criterios de información Akaike, Hannan-Quinn, Schwarz y la sumatoria de los residuales al cuadrado. Como es tradicional el término de error estocástico viene definido por µ

t

. Es importante destacar la relevancia que tienen los coeficientes E1, E2,… Ep. Ellos representan los efectos de volatilidad acumulada para los diferentes momentos de análisis (1,2,...,p), si estos son positivos y superan la unidad es posible advertir un fenómeno de explosión de varianza o acumulación de la volatilidad “clustering”, por lo que se vislumbra que el activo financiero tiende a ser cada vez más riesgoso; si en su lugar, los coeficientes se aproximan a cero, las presiones sobre la volatilidad irán desapareciendo ofreciendo más seguridad a los inversionistas. Considerando que los términos de error se distribuyen con media igual a 0 y varianza

, un modelo ARCH exhibe el siguiente tratamiento frente a la varianza:

, un modelo ARCH exhibe el siguiente tratamiento frente a la varianza:

Ahora bien, si la varianza es función de los errores cuadráticos retardados “innovations”, cuyos coeficientes alpha capturan el fenómeno de acumulación de la varianza “varianza explosiva” es posible adicionar a su explicación el efecto intertemporal que producen las varianzas de periodos anteriores; esto mismo conduce a la construcción del modelo condicional autorregresivo generalizado con heteroscedasticidad GARCH(p,q) donde p constituyen los rezagos en los residuales al cuadrado y q los retardos en la varianza.

Análisis a las series de tiempo: S&P 500, Nasdaq y Dow Jones

Las gráficas 1, 2 y 3 exhiben el comportamiento descrito por las cotizaciones diarias del S&P 500, Nasdaq y Dow Jones Industrial para el periodo comprendido entre el 24 de febrero del 2000 hasta el 17 de febrero del 2014. Las oscilaciones experimentadas por los índices del mercado norteamericano advierten una mayor desviación estándar en el Dow Jones Industrial, mientras que el S&P 500 se destaca por ser el más estable.

Uno de los acontecimientos más notables durante el periodo de estudio descansa en el desplome de los mercados a partir de factores como el atentado terrorista al World Trade Center el 11 de septiembre de 2011, que ocasionó nerviosismo en los inversionistas por factores asociados a la política de seguridad nacional e internacional de los Estados Unidos. La incertidumbre generada por este fenómeno generó una reducción significativa en los flujos de capitales que acentuó las desvalorizaciones de buena parte de los activos financieros norteamericanos.

La recuperación de la economía norteamericana se consolidaría a partir del 2003 y se prolongaría hasta el 2008 cuando se suscitó la desvalorización de los activos financieros del sector inmobiliario y la crisis del sub-prime. El crecimiento de la economía había permitido el crecimiento sistemático de créditos hipotecarios que estimularon la finca raíz y la cotización de los títulos dentro de los portafolios de inversión. El exacerbado crecimiento de las tasas de interés, el deterioro de la capacidad productiva y el vertiginoso desplome de los activos financieros integraron los factores para una crisis económica a escala mundial. Uno de los acontecimientos más destacados se evidenció el 15 de septiembre de 2008 cuando Lehman Brothers se declaró en bancarrota y cuya caída significaba para los inversionistas un escenario de incertidumbre y desconfianza en el mercado.

En la actualidad, después de una serie de políticas fiscales y monetarias de tipo expansivo para recuperar la demanda agregada; las autoridades económicas de los Estados Unidos han considerado que dichos esfuerzos pueden relajarse. Es así como el 22 de mayo de 2013 el presidente de la Reserva Federal FED, Ben Bernanke anunció el recorte del programa de estímulos monetarios. Esta noticia implicó un ambiente de fuertes turbulencias en el sistema financiero internacional, lo que, obligó a la FED el 18 de septiembre a mantener inalteradas sus tasas de interés y las compras de bonos para estabilizar el clima de confianza por parte de los agentes económicos, explicando que el desmonte sería gradual y no comprometería las metas de los agregados macroeconómicos. Finalmente, el 18 de diciembre se produjo el anuncio sobre el recorte del programa que comenzaría en firme en febrero de 2014.

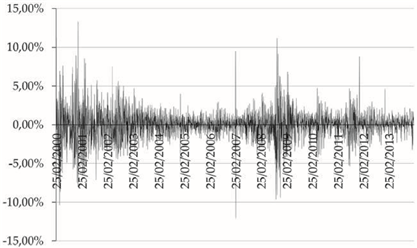

Los Gráficos 4, 5 y 6 exponen la evolución de los rendimientos que, por jornada diaria de cotización, se han registrado para cada uno de los índices del mercado desde el 25 de febrero de 2000 hasta el 17 de febrero de 2014. Uno de los aspectos que caracteriza las series de tiempo analizadas consiste en su permanente volatilidad, especialmente entre 2001-2003 y 2008-2009.

Engle destaca que los retornos de los activos financieros son de difícil predicción, tienen además una distribución estadística de colas gordas y cuentan con acumulación de la volatilidad. Al respecto, el Cuadro 1, que presenta información estadística básica, permite advertir que los rendimientos promedio diarios son muy cercanos a cero, esto significa una distribución de frecuencias con media que tiende a cero, mientras que las desviaciones típicas, que usualmente son tomadas como medidas de riesgo, son relativamente pequeñas, pero inestables; en términos simples, el comportamiento de la varianza no es una constante, particularmente durante los eventos experimentados entre 2001-2003 y 2008-2009; de otra parte, el coeficiente de asimetría (S) para el Nasdaq y el Dow Jones es muy cercano a cero, en tanto que el S&P 500 si bien cumple esa condición, es comparativamente distante frente a los dos mercados de estudio. En un escenario propio de una distribución normal, se espera que el coeficiente sea cero, garantizando la simetría estadística y la existencia de un juego de suma cero, donde la existencia de rendimientos negativos sea neutralizada por la presencia de rendimientos positivos de frecuencias y magnitudes idénticas.

En una distribución normal, el valor esperado del coeficiente de curtosis (K) debe ser lo más cercano posible a 3; con esto se asegura que la magnitud existente entre las colas sea equivalente. Como puede evidenciarse en el Cuadro 1, los tres activos financieros indican valores superiores a la curtosis normal y en consecuencia, implican que el estadístico de Jarque-Bera tienda a ser muy grande mientras que la probabilidad de aceptar la hipótesis nula de normalidad tiende a ser muy pequeña.

La información estadística básica sugiere, entonces, que como el valor p de la prueba de Jarque Bera es nulo, dado que el coeficiente es demasiado elevado, se rechaza la hipótesis de normalidad para los retornos del S&P 500, Nasdaq y Dow Jones Industrial. Precisamente una de las pruebas gráficas que Engle presenta en discurso de agradecimiento por el Nobel de economía en 2003 descansa en el análisis de la distribución de cuántiles que en el caso de normalidad en las series debería comportarse como una línea recta, pero en el caso de presentarse valores extremos que potencien la curtosis describen una forma de S. Lo que efectivamente sucede en los tres mercados tal y como se evidencia en la gráfica 7.

El tratamiento de una serie financiera supone un análisis sobre la estacionariedad, esto significa que su media y su varianza no deben cambiar sistemáticamente en el tiempo. A nivel muy elemental Si Yt es una variable financiera se pretende que:

Lo que en realidad es una aproximación al concepto de estacionariedad, dado que un proceso estacionario exige que todos los componentes de su distribución de probabilidad se mantengan constantes en el tiempo. Ahora bien, si Yt es explicada por una o varias versiones rezagadas de sí misma (por ejemplo: Yt-1, Yt-2,…, Yt-n) es posible que describa un patrón de caminata aleatoria; en otras palabras, si su coeficiente de impacto es igual a la unidad (Ÿ=1) se produce un fenómeno de raíz unitaria que supone que la serie es no estacionaria y, en consecuencia, su media y varianza cambian con el tiempo, lo anterior desvirtúa las conclusiones de las pruebas de inferencia convencionales tanto globales como individuales debilitando el análisis y la capacidad predictiva de un modelo. Al respecto, un problema de raíz unitaria básica puede resumirse como:

Dónde: -1 ≤ Ω ≤ 1; εt = Ruido blanco.

Dickey-Fuller (1976) plantearon que una serie de tiempo podía ajustarse mediante la aplicación de un operador en primeras diferencias (∆Y t = Yt - Yt-1) y una distribución τ (tau).

La hipótesis nula sugiere que si δ = 0, entonces Ω = 1, lo que significa que, existe evidencia de raíz unitaria o ausencia estacionariedad en la serie financiera. Por otro lado, la hipótesis alterna soportada en

sugiere la no existencia de raíz unitaria y la presencia de estacionariedad en la serie.

sugiere la no existencia de raíz unitaria y la presencia de estacionariedad en la serie.

En el análisis práctico de la prueba Dickey-Fuller aumentada se basa en tres variantes, la primera contempla un modelo sin tendencia y sin intercepto, la segunda únicamente con intercepto y la última versión que incluye simultáneamente tendencia e intercepto. Siendo Rt el retorno de un activo financiero calculado mediante variaciones logarítmicas se tiene:

Del ejercicio se obtiene el estadístico τ (tau) correspondiente al retorno rezagado Rt-1 que debe ser lo suficientemente grande en términos absolutos como para no ser sobrepasado por sus valores críticos al 10%, 5% y 1%, esto garantiza la aceptación de la hipótesis alterna, es decir, la existencia de retornos estacionarios. Tal y como lo evidencian los coeficientes presentados en los cuadros 2, 3 y 4, los rendimientos del S&P 500, Nasdaq y Dow Jones Industrial no presentan problemas de raíz unitaria al 5% de significancia.

Después de verificar que las series temporales no presentan problemas de raíz unitaria, es necesario efectuar un estudio sobre las correlaciones seriales o también denominadas autocorrelaciones. En principio una variable puede relacionarse consigo misma a través del tiempo, en efecto; los rendimientos históricos de un activo financiero pueden generar expectativas en los inversionistas que, en cierta forma, ejercen un efecto sobre los rendimientos actuales. Siguiendo a Engle un instrumento para verificar patrones de autocorrelación significativos en los retornos subyace en la información suministrada por los correlogramas que constituyen una primera idea sobre la predictibilidad de la serie. De otra parte, las correlaciones seriales de los rendimientos al cuadrado o sus términos absolutos advierten la posibilidad de un agrupamiento de la volatilidad.

Uno de los procedimientos consiste en estimar un modelo autorregresivo de primer orden sobre los rendimientos de los activos financieros así:

Luego se obtienen los residuos, sus autocorrelaciones y correlaciones parciales para una serie de retardos. Los resultados del proceso efectuado para los tres mercados norteamericanos se exhiben en el Cuadro 5. Los coeficientes autorregresivos de primer orden son significativos en cada uno de los modelos. Dado que el estadístico de Durbin-Watson no constituye una herramienta idónea para identificar patrones de autocorrelación de los residuales en modelos con variables retardadas se utiliza el estadístico h definido así:

Cuadro 5: Regresión de los retornos del S&P 500, Nasdaq y Dow Jones Industrial como un proceso autorregresivo de primer orden

Fuente: Elaboración del autor.

Si el coeficiente de autocorrelación estimado de primer orden entre los residuales U es igual a cero, entonces el estadístico h sigue una distribución normal estandarizada h ~ N(0, 1) es decir, con media nula y varianza unitaria. Si |h|>1,96 es posible rechazar la hipótesis nula de que р=0, lo que significa que existe evidencia de autocorrelación. Teniendo en cuenta que para los tres modelos el estadístico h supera el valor de 1,96 se advierte que existe un fenómeno de autocorrelación, lo que efectivamente puede evidenciarse si se observa el comportamiento de los residuales en el correlograma dado que sus valores de significancia están por debajo del 5% (Ver Anexos 1, 2 y 3).

Originalmente Engle planteaba que la correlación serial de las rentabilidades diarias al cuadrado que son estadísticamente significativas pueden advertir la presencia de heterocedasticidad (Engle, 2003: 336). Los estudios recientes (V. gr. Perez y Castaño, 2006) sugieren que es posible advertir a partir del correlograma de los residuos al cuadrado obtenidos de un proceso autorregresivo de primer orden sobre los retornos de un activo financiero, un primer indicio de la existencia de heterocedasticidad. Si los coeficientes de autocorrelación descienden de forma paulatina hacia cero, el proceso se torna explosivo. Para determinar claramente si el modelo presenta patrones de heterocedasticidad es posible aplicar pruebas gráficas y formales.

La heterocedasticidad, desde una óptica algebraica supone que el valor esperado de los residuales al cuadrado  tiene una varianza pequeña y constante

tiene una varianza pequeña y constante  . Así:

. Así:

Un primer instrumento de detección de patrones de heterocedasticidad estriba en el comportamiento descrito por los errores residuales en el tiempo. Las Gráficas 7, 8 y 9 ilustran la situación experimentada por el S&P 500, el Nasdaq y el Dow Jones Industrial durante el periodo comprendido entre el 28 de febrero del 2000 hasta el 17 de febrero de 2014. En términos financieros la heterocedasticidad de un activo implica que sus rendimientos no son estables, en consecuencia son volátiles y riesgosos.

Gráfica 7 : Comportamiento de los residuales obtenidos en los retornos del S&P 500 como un proceso autorregresivo de primer orden

La serie de residuales del S&P 500 supone un comportamiento especialmente errático entre 2001 y 2003 que posteriormente se torna más estable hasta 2007 y retoma fuerza entre 2008 y parte de 2010. El último periodo supone un difícil regreso a la estabilidad que en los últimos días parece alcanzarse.

Gráfica 8 : Comportamiento de los residuales obtenidos en los retornos del Nasdaq como un proceso autorregresivo de primer orden

Con respecto a la conducta evidenciada por los residuales del Nasdaq llama poderosamente la atención la severa volatilidad suscitada en el año 2001, turbulencia que se explicaría por los ataques terroristas perpetrados al World Trade Center el 11 de septiembre y cuyo impacto produjo pérdida de confianza y fuga de capitales de inversión. La situación se estabiliza en 2003 y se prolongaría hasta 2007. El escenario descrito entre 2008 y 2009 es especialmente explicado por la crisis financiera internacional originada en la sobrevaloración del mercado inmobiliario estadounidense. Posteriormente la inestabilidad en el mercado tecnológico se ha reducido con particular lentitud.

El Dow Jones Industrial comprende un indicador aproximado que compila el comportamiento de las 30 empresas más importantes del mercado norteamericano. Su volatilidad es más notoria entre 2001 y 2003. Después de un periodo de estabilidad, los efectos de la crisis internacional son indiscutiblemente visibles entre 2008 y 2009. Recientemente el indicador ha desarrollado una tendencia de paulatina reducción del riesgo.

Gráfica 9 : Comportamiento de los residuales obtenidos en los retornos del Dow Jones Industrial como un proceso autorregresivo de primer orden

Una de las pruebas formales de heterocedasticidad más extensamente utilizadas es el test de White que explica los errores residuales al cuadrado en función de las variables independientes consideradas en la ecuación original, sus valores cuadráticos y sus productos cruzados a la primera potencia. White demostró que si el valor del estadístico F de Fischer Snedecor o el producto obtenido del coeficiente de determinación y el tamaño de la muestra (que se aproxima a una distribución ji cuadrada) superan sus valores críticos, la conclusión es que existe heterocedasticidad. El punto de referencia es el 5% de significancia estadística, razón por la cual el valor de probabilidad debe superar esa condición para no rechazar la hipótesis nula de homocedasticidad. El Cuadro 6 permite concluir que para todos los casos el comportamiento de los residuales de los rendimientos de los mercados financieros presentó heterocedasticidad.

Cuadro 6: Prueba de Heterocedasticidad de White con productos cruzados: Prueba de Heterocedasticidad de White con productos cruzados

Fuente: Elaboración del autor.

Con el ánimo de obtener un procedimiento concluyente se aplicó la prueba del multiplicador de Lagrange para determinar la existencia de heterocedasticidad condicional autorregresiva o efecto ARCH que consiste en la construcción de un modelo explicativo de los residuales al cuadrado que dependen de sus versiones anteriores, en general se plantea así:

Aquí, igual que como en la prueba general de heterocedasticidad de White, si los valores calculados de la distribución F y Ji cuadrada son superados por sus versiones críticas, el valor p tenderá a ser muy pequeño y, si se encuentra por debajo del 5% se concluye la existencia de heterocedasticidad condicional autorregresiva para cada uno de los mercados con retardos de 1 a 3, tal y como puede advertirse en el Cuadro 7.

PRINCIPALES RESULTADOS DE LOS MODELOS

La evaluación de las series temporales señala la pertinencia de los modelos de heterocedasticidad condicional autorregresiva para los tres mercados financieros de los Estados Unidos, pero además advierte la necesidad de explicar las fluctuaciones de los retornos a partir de fenómenos de naturaleza histórica cuya incidencia exacerbó su comportamiento habitual. Teniendo en cuenta lo anterior, se introdujeron en las ecuaciones de rendimientos continuos de los diferentes mercados variables dummy como el atentado terrorista a las torres gemelas el 11 de septiembre de 2001, la caída de Lehman Brothers el 15 de septiembre de 2008, la aprobación de la Ley de estabilización económica por parte de la Cámara de Representantes de los Estados Unidos el 3 de octubre de 2008, el primer anuncio de la Reserva Federal por el desmonte gradual del plan de compras de los bonos de deuda y el consecuente incremento de los tipos de interés comunicado por Bernanke el 22 de mayo de 2013, el segundo anuncio de la FED por mantener inalteradas las compras de bonos en USD 85000 millones mensuales el 18 de septiembre de 2013 y finalmente el anuncio del Tapering el 18 de diciembre del mismo año.

Para el caso del S&P 500 los efectos del atentado terrorista perpetrado al World Trade Center y la quiebra de Lehman Brothers constituyeron los dos eventos con mayor significancia estadística en el periodo de análisis. De otra parte, la volatilidad de los residuales sugiere que el efecto de un retardo en los errores ARCH (1) es inferior a la unidad, eso implicaría una importante reducción en términos de la varianza explosiva y el hecho de que las noticias no exacerban el comportamiento de los rendimientos del mercado, sin embargo, si se considera el impacto de la volatilidad anterior a partir de un efecto GARCH (1) la suma de los coeficientes es muy cercana a uno, lo anterior evidenciaría que en la actualidad el S&P 500 tiende a estabilizarse de forma muy lenta y el impacto de los riesgos del pasado aún persiste en el comportamiento de los riesgos presentes. En la medida en que la suma de los coeficientes descienda, el mercado se tornará más seguro, como se observa en el Cuadro 8.

Cuadro 8: Estimación Out-Put de los Retornos del S&P 500 mediante un modelo GARCH(1,1)

Fuente: Elaboración del autor.

Asimismo, el Cuadro 9 permite evidenciar la reducción del efecto ARCH hasta con tres rezagos, confirmando el planteamiento del modelo al 5%.

Para modelar los rendimientos del Nasdaq las dos variables significativamente estadísticas en el análisis fueron nuevamente el ataque a las torres gemelas y Lehman Brothers, lo que incluso se había anticipado en el examen de las series de tiempo. Factores como la Ley de Estabilización económica o los anuncios de la Reserva Federal no fueron significativos tanto en la ecuación de retornos como en la de varianza. Respecto al análisis de volatilidades fue necesario acudir a una estructura ARCH(4), dado que, las variables GARCH no fueron lo suficientemente significativas o la prueba del multiplicador de Lagrange no soportaba sus resultados hasta 3 rezagos.

El análisis de la volatilidad de los rendimientos del Nasdaq permite advertir que los retardos más lejanos tuvieron un impacto superior a los retardos más cercanos. Esta situación permite advertir el hecho de que el indicador del mercado tecnológico tiene rendimientos cada vez más estables y que el efecto de una volatilidad exacerbada en el pasado tiende a reducirse, como se ve en el Cuadro 10.

Cuadro 10: Estimación Out-Put de los Retornos del Nasdaq mediante un modelo ARCH(4)

Fuente: Elaboración del autor.

El Cuadro 11 proporciona la evidencia del multiplicador de Lagrange para reducir los efectos ARCH incluso hasta tres retardos.

Finalmente el tercer modelo propuesto (Cuadro 12) advierte que los retornos del Dow Jones Industrial fueron afectados por las mismas variables que constituyeron el estudio de los anteriores modelos, sin embargo, se destaca que, el atentado terrorista del 11 de septiembre tuvo un impacto mayor sobre los rendimientos del mercado que la caída de Lehman Brothers, lo que se diferencia del S&P 500 y el Nasdaq. Factores como los anuncios de la FED o la Ley de Estabilización Económica no fueron lo suficientemente significativos en la explicación del modelo. Por su parte, la ecuación de varianza contiene dos retardos en los residuales y un retardo en la varianza lo que define un modelo GARCH (2,1). La suma de los coeficientes es prácticamente igual a la unidad por lo que no es posible suponer que este indicador del mercado se encuentre en un periodo de estabilización y, en consecuencia, constituye un mercado donde el riesgo financiero es permanente. El Cuadro 13 exhibe la prueba de multiplicador de Lagrange que soporta la construcción del modelo.

Cuadro 12: Estimación Out-Put de los Retornos del Dow Jones Industrial mediante un modelo GARCH(2,1)

Fuente: Elaboración del autor.

CONCLUSIONES

La modelación GARCH permitió establecer la complejidad subyacente al explicar los rendimientos de los mercados norteamericanos, así como la relevancia existente de los efectos generados por las noticias o fenómenos que potencialmente ejercen influencia sobre la volatilidad o riesgo financiero a través de los errores residuales, mientras en paralelo permite advertir el impacto del riesgo pasado sobre el riesgo presente a partir de las varianzas retardadas. Si la suma de los coeficientes que explican la ecuación de varianza o riesgo financiero superan la unidad, el mercado se caracteriza por ser cada vez más inestable, de otro modo, esto es, la suma de los coeficientes se encuentra por debajo de 1, entonces el mercado se torna cada vez más seguro.

En este estudio se ha comprobado que para el S&P 500 y el Nasdaq el fenómeno de acumulación de la varianza que exacerba el riesgo financiero es levemente inferior a la unidad, lo que sugiere que dichos mercados regresan de forma progresiva a una situación de estabilidad. De otra parte, el Dow Jones Industrial evidencia una suma de coeficientes prácticamente unitaria, lo que implica que el riesgo financiero si bien no reacciona de forma exacerbada, se mantiene de forma persistente.

El estudio reveló que fenómenos como la aprobación de la Ley de Estabilización Económica, los anuncios de la FED, los comunicados de Bernanke y la decisión del Tapering no fueron lo suficientemente significativos en la explicación del riesgo financiero. Frente a los rendimientos de los mercados norteamericanos los tres procesos de modelación coinciden en que el atentado terrorista del 11 de septiembre y la caída de Lehman Brothers constituyeron los dos hechos más significativos durante el periodo de análisis. Contrario a lo que sucede con el S&P 500 y el Nasdaq, en el caso del Dow Jones, los efectos del atentado a las torres gemelas tuvo un mayor impacto sobre los retornos diarios que el generado por la declaración de bancarrota de Lehman Brothers.