Services on Demand

Journal

Article

Indicators

-

Cited by SciELO

Cited by SciELO -

Access statistics

Access statistics

Related links

-

Cited by Google

Cited by Google -

Similars in

SciELO

Similars in

SciELO -

Similars in Google

Similars in Google

Share

Entramado

Print version ISSN 1900-3803

Entramado vol.11 no.1 Cali Jan./June 2015

https://doi.org/10.18041/entramado.2015v11n1.21102

http://dx.doi.org/10.18041/entramado.2015v11n1.21102

Proceso analítico jerárquico para evaluar tres laboratorios virtuales en la educación superior*

Analytical, hierarchical process to evaluate three virtual labs in a higher education setting

Processo analítico hierárquico para avaliar três laboratórios virtuais na educação superior

Campo Elias Riaño-Luna**, Martha Liliana Palomino-Leiva***

* Artículo resultado del proyecto PG-14. Enfoque e implantación de un entorno virtual de prácticas para la enseñanza y el aprendizaje de un curso metodológico experimental. Tecnología de café. Financiado por la Universidad Nacional Abierta y a Distancia (UNAD).

** Doctor EaD y Tecnología Instruccional, NOVA University. Docente asistente de la ECBTI de la UNAD - Universidad Nacional Abierta y a Distancia. Bogotá, Colombia. campo.riano@unad.edu.co

*** Magister en Educación Virtual, UNAD, Docente Ocasional, Universidad Nacional Abierta y a Distancia, Escuela de Ciencias Sociales, Artes y Humanidades, Dosquebradas - Risaralda, Colombia. martha.palomino@unad.edu.co

Este es un artículo Open Access bajo la licencia BY-NC-SA (http://creativecommons.org/licenses/by-nc-sa/4.0/)

Cómo citar este artículo: RIAÑO-LUNA, Campo Elías y PALOMINO-LEIVA, Martha Liliana. Proceso analítico jerárquico para evaluar tres laboratorios virtuales en la educación superior En: Entramado. Enero - Junio, 2015 vol. 11, no. 1, p. 194-204, http://dx.doi.org/10.18041/entramado.2015v11n1.21102

Recibido: 06/02/2014 Aceptado: 15/12/2014

Resumen

El objetivo de este trabajo fue estandarizar un protocolo bajo un proceso analítico jerárquico (AHP), para evaluar el uso y la pertinencia de los laboratorios virtuales o prácticas académicas simuladas en un ambiente virtual de aprendizaje de la educación superior a distancia. Para el efecto se siguió un enfoque cuantitativo, tipo descriptivo, para evaluar y categorizar jerárquicamente tres laboratorios virtuales comerciales de química. En el proceso participaron diez estudiantes y siete profesores expertos en cursos teóricos prácticos, ofertados en aula virtual bajo la plataforma Moodle. Los criterios analizados fueron: funcionalidad (FUN), Habilidad (FIA), usabilidad (USAB), eficiencia (EFI), mantenibilidad (MAB), portabilidad (POR), aspectos técnicos (ASPT), aspectos psicopedagógicos (ASPS), aspectos comunicacionales (ASPC) y los aspectos administrativos (ASPA) de los laboratorios virtuales. El análisis y la jerarquización de los criterios y los laboratorios virtuales (LVs) con estas variables se realizaron matrices de comparación pareadas. La razón de consistencia entre las decisiones pareadas que realizaron los evaluadores fue de 0.05885, y al ser esta menor a 0.10, se concluye que es una metodología pertinente para analizar y evaluar objetivamente laboratorios virtuales y además los clasifica jerárquicamente, acorde con sus atributos.

Palabras clave: Laboratorios virtuales, proceso analítico jerárquico, matrices de comparación, normalización, índice de consistencia geométrico, razón de consistencia.

Abstract

The purpose of this work was to standardize a protocol using an analytical hierarchical process (AHP) to evaluate the use and relevance of virtual labs or simulated academic practices in a virtual learning environment for distance higher education. To this end, a quantitative, descriptive approach was used for evaluating and making a hierarchical categorization of three virtual commercial chemistry labs. Ten students and seven professors, who are experts in theoretical and practical courses offered in virtual classrooms, participated in the study, using the Moodle e-learning platform. The following criteria were analyzed: functionality (FUN), reliability (FIA), usability (USAB), efficiency (EFI), maintainability (MAB), portability (POR), technical aspects (ASPT), psycho pedagogical aspects (ASPS), communicational aspects (ASPC), and administrative aspects (ASPA) of virtual labs. The review and hierarchical classification of the criteria and virtual labs (VLs) with these variables were carried out using paired comparison matrices. The consistency ratio of the evaluators' paired decisions was 0.05885. Since it was lower than 0.10, it can be concluded that this approach is suitable not only for an objective review and analysis of virtual labs, but also for a hierarchical classification of virtual labs based on their attributes.

Keywords: Virtual labs, analytical hierarchical process, comparison matrices, standardization, geometric consistency index, consistency ratio.

Resumo

O objetivo desse estudo foi o de padronizar um protocolo no âmbito de um processo analítico hierárquico (AHP) para avaliar o uso e a pertinência dos laboratórios virtuais ou práticas acadêmicas simuladas em um ambiente virtual de aprendizagem de educação superior a distância. Para esse efeito foi seguida uma abordagem quantitativa do tipo descritivo para avaliar e categorizar hierarquicamente 3 laboratórios virtuais comerciais de química. No processo participaram l0 estudantes e 7 professores, peritos em cursos teóricos e práticos oferecidos em sala de aulas virtuais na plataforma Moodle. Os critérios analisados foram: funcionalidade (FUN), confiabilidade (FIA), usabilidade (USAB), eficiência (EFI), capacidade de manutenção (MAB), portabilidade (POR), aspectos técnicos (ASPT), aspectos psicopedagógicos (ASPS), aspectos comunicacionais (ASPC) e os aspectos administrativos (ASPA) dos laboratórios virtuais. A análise e a hierarquização dos critérios e laboratórios virtuais (LVs) com essas variáveis foram realizadas com matrizes de comparação pareada. A razão para a consistência entre as decisões pareadas que os avaliadores realizaram foi de 0,05885 e, sendo esta inferior a 0,l0 se conclui que essa metodologia é pertinente para analisar e avaliar objetivamente os laboratórios virtuais além de os classificar hierarquicamente de acordo com seus atributos.

Palabras-chave: Laboratórios virtuais, processo analítico hierárquico, matrizes de comparação, normalização, índice de consistência geométrico, razão de consistência.

Introducción

Los cursos teórico - prácticos de los programas de ingeniería, y en especial los ofertados en la modalidad de educación a distancia, que se sustentan en un enfoque constructivista, requieren de procesos de comunicación e interacción permanente entre los actores, materiales, recursos tecnológicos y los laboratorios o prácticas en contexto. En estos, los estudiantes aprenden asociando nuevas experiencias a conocimientos previos para construir conocimientos más complejos (Sherman y Kurshan, 2005). De manera que las prácticas en el área de las tecnologías aplicadas son importantes, debido a que en estas el estudiante disipa dudas, comprueba los aspectos teóricos y, en general, fortalece su aprendizaje a través del descubrimiento (Bruner, 1966) y su interacción.

Para potenciar este tipo de aprendizajes el uso de tecnologías de la información y la comunicación (TICs) ha sido fundamental puesto que a través de multimedia, video juegos, programas de simulación y los micromundos han potenciado el desarrollo de laboratorios virtuales, tal como lo proponen varios autores (Hlupic y Mann, 2002; Le y Le, 2007; Ramos, Peláez, García y Ruiz, 2007; Azadeh, Shirkouhi y Rezaie, 2009).

De estas tecnologías, el laboratorio virtual es un simulador que mediante el uso de lenguajes de programación interactiva, los estudiantes reciben información y realizan actividades de manera autónoma. Laboratorios y prácticas que tienen como propósito potenciar el desarrollo de habilidades y nuevas formas de conocimiento.

Sin embargo, su selección debe ser cuidadosa y hacerse con criterios objetivos de calidad, puesto que se debe determinar si se adecuan al entorno de aprendizaje (Marqués, 1995, 2004; Galvis, 2000, Mcdougal y Squires, 2001). Es decir, si permite el diálogo con el usuario o son interactivos (Marqués, 2004, 2005). Si los estudiantes mejoran sus aprendizajes mediante su aplicación específica (Jadhav y Sonar, 2009), y si su aplicación corresponde con los objetivos específicos del componente práctico del curso o del programa (González y Wagenaar, 2003), sumado a los requerimientos que se necesitan para insertarlos dentro de las plataformas donde se ofrecen los cursos en línea (Verma, Gupta y Singh, 2008).

Igualmente, a juicio de Office of Technology Assessment, 1989; Mcdougal y Squires, 2001; Díaz-Antón, 2002; Lê y Lê, 2007; Cataldi, Donnamaria y Lage, 2009; Cataldi, Chiarenza, Dominighini, Donamaria y Lage, 2012, la calidad del software está determinada no sólo por los aspectos técnicos del producto sino por el diseño pedagógico y los materiales que le dan soporte.

De acuerdo con los anteriores conceptos, en este trabajo se presenta la técnica de proceso analítico jerárquico (AHP), como herramienta para clasificar jerárquicamente tres laboratorios virtuales comerciales_A, B y C, para cursos de química analítica ofertados en línea. Para el efecto se valoraron 10 criterios, extractados de trabajos científicos sobre la temática (Marqués, 1995, 2004, 2005; Verma, Gupta y Singh, 2008; Rada, 2013; Riaño y Palomino, s.f.) y se siguió el procedimiento de análisis jerárquico (AHP) propuesto por Davis y Williams (1994) y Saaty (2001, 2009).

Los resultados muestran que con la aplicación de este tipo de herramientas de decisión multicriterio se logra una mayor objetividad en el resultado final de selección y aplicación de un laboratorio virtual en la educación superior.

1. Marco teórico

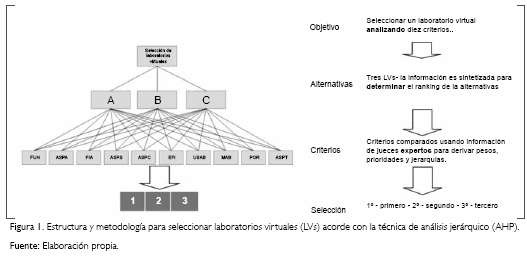

El proceso analítico jerárquico (AHP), es una técnica multicriterio que busca reducir la brecha entre la subjetividad y la objetividad, cuando de tomar decisiones complejas se trata. El problema de decisión se modela mediante una jerarquía en cuyo vértice superior está el principal objetivo del problema, meta a alcanzar y, en la base, se representan los criterios (los cuales a su vez se pueden estructurar también en jerarquías), con base en los cuales se toma la decisión (Lai, Wong y Cheung, 2002). En los niveles intermedios se hallan las posibles alternativas a evaluar, tal como se ilustra en la Figura 1.

En este trabajo se siguieron los procedimientos propuestos por Davis y Williams (1994) y por Saaty (2001, 2009), quienes recomiendan:

- Partir del interés que puede tener un decisor de seleccionar entre un conjunto de alternativas, cuál de ellas es más interesante para su propósito.

- Definir cuáles criterios se van a utilizar para establecer la selección, es decir, cuáles son las características que pueden hacer más deseable una alternativa sobre otra.

- Y decidir si todos los criterios influyen de la misma forma en la alternativa de interés, o bien influyen en pesos de importancia distintos. El experto puede cuantificar el grado de presencia o ausencia de determinado criterio, generalmente estos pesos de importancia son diferentes y requieren de una ponderación previa.

Para el efecto, en el presente trabajo se utilizó una herramienta validada mediante el método Delphi de consulta a expertos, con el cual se identificaron y se validaron consensuadamente los criterios que determinan la pertinencia de los laboratorios virtuales en la educación superior (Riaño y Palomino, s.f.). Esta herramienta tiene una Habilidad o alfa de Cronbach de r=0.814, y un nivel de confianza del 95% (p<0.05) (Riaño y Palomino, s.f.). Los criterios que se evaluaron en cada uno de los tres laboratorios virtuales se muestran en la Tabla 1 (Ver pág. 197).

Y para comparar objetivamente estos criterios, se construyó una escala de Likert, elaborada siguiendo las orientaciones de la Office of Technology Assessment (1989), de Vargas (1990), de Saaty (2001, 2009), de Davis y Williams (1994), Ossadnik y Lange (1999) y de Cabala (2010) para este proceso analítico jerárquico (AHP), tal como se presenta en la Inicialmente, se identificaron los criterios y escalas de evaluación más comunes para construir y evaluar laboratorios virtuales, siguiendo la metodología Delphi (Landeta, 2002; Altschuld, 2003; Riaño y Palomino, s.f), la cual permitió, además, la construcción de la escala de Likert y los valores indicados en las Tablas 1 y 2.

Seguidamente se seleccionaron diez estudiantes que habían cursado la materia y siete docentes expertos en educación a distancia y en tecnologías de la información y la comunicación; quienes por triplicado evaluaron cada uno de los tres laboratorios virtuales de química, con la escala de evaluación construida para este estudio.

Para comparar entre sí los tres laboratorios virtuales, se siguieron los procedimientos desarrollados por Saaty (1990, 2001, 2009) y Davis y Williams (1994), quienes proponen en primera instancia corroborar la consistencia de las respuestas de los decisores. Para el efecto, se siguieron siete etapas: en la primera con los valores otorgados por los decisores se construyó una matriz de decisión o comparación; en la segunda se normalizaron los datos de la matriz de comparación; en la tercera se calcularon los valores propios de las decisiones; en la cuarta se priorizaron los criterios; en la quinta se calculó el máximo valor propio o lambda máximo; en la sexta se calculó la consistencia de las decisiones y en la séptima etapa se realizó la comparación de los laboratorios virtuales objeto de estudio.

Las etapas descritas en el párrafo anterior permitieron comparar pareadamente cada criterio y calcular el vector de prioridad (auto vector o eigen value), el índice de consistencia (CI) y la razón de consistencia (CR) (por sus siglas en inglés) (Saaty, 2001). Estos índices (CI y CR) permiten definir hasta qué punto la decisión en la comparación por pares es consistente y no está influenciada por sesgos o por contradicciones (Ozdemir, 2005; Alonso, 2006). Es decir, validan que los juicios no tengan errores entre ellos, o no se haya producido contradicciones en los mismos. Un valor de este coeficiente inferior a 0.10 es considerado aceptable. Para aquellos casos en que sea mayor, las opiniones y los juicios deben ser reevaluados.

Finalmente, los expertos evaluaron con la misma escala de Likert cada uno de los diez criterios seleccionados en cada uno de los tres laboratorios virtuales comerciales (A, B y C) objeto del trabajo. El procedimiento matemático continuó hasta determinar el orden jerárquico o la prioridad con base en los factores de peso de los criterios que intervienen en la toma de decisiones, según los expertos (Alanbay, 2005; Saaty, 200l, 2009); factores que representan en forma indirecta los elementos de calidad de un laboratorio virtual I (ver Tablas 3 a 10).

El tratamiento matemático y la clasificación numérica de los criterios evaluados se realizó en excel, acorde con los conceptos de Vargas (1990), de Davis y Williams (1994), de Lai, Wong y Cheung (2002), de Alanbay (2005) y de Saaty (2001, 2009), como se presentan en las Tablas 3 a 10.

3. Resultados

En este apartado se describe el procedimiento seguido y los resultados generales para cada una de las etapas seguidas:

Etapa 1. Construcción de la matriz de decisión. Con los criterios de calidad definidos en la Tabla 1 y la escala de Likert, Tabla 2, cada decisor realizó el análisis por pares. Es decir, se comparó la importancia de cada uno de los criterios de calidad de manera biunívoca o par a par, los criterios establecidos verticalmente contra los criterios establecidos horizontalmente: fueron Funcionalidad (FUN) con Fiabilidad (FIA); Funcionalidad (FUN) con eficiencia (EFI), hasta llegar a comparar Funcionalidad (FUN) con los aspectos académicos (ASPA). Y así sucesivamente, hasta comparar cada uno de los criterios verticales con los horizontales, tal como se indica en la Tabla 3.

Para el presente trabajo los decisores consideraron que la funcionalidad (FUN), la fiabilidad (FIA), la usabilidad (USAB), la eficiencia (EFI), la mantenibilidad (MAB) y los aspectos técnicos (ASPT), tienen la misma importancia- valor igual a para la selección de laboratorios virtuales. Así mismo, los decisores consideraron que la funcionalidad (FUN) es ligeramente más importante-valor de 3 que la portabilidad (PQR) y que los aspectos académicos (ASPA); y medianamente más importante-valor de 2 que los aspectos comunicacionales (ASPC). También se observa que los aspectos psicopedagógicos (ASPS) fueron considerados más importantes-valor de 3, que la funcionalidad (FUN)- valor de 1/3_o el recíproco, tal como se indica en la Tabla 3. Igualmente, para los decisores la eficiencia (EFI) es más importante-valor de 3 que la portabilidad (PQR) y que los aspectos académicos (ASPA).

En la fila de los aspectos psicopedagógicos (ASPS) se nota que este criterio fue considerado más importante-valor de 5 que la portabilidad (PQR). Los aspectos psicopedagógicos (ASPS) son ligeramente más importantes-valor de 3 que la funcionalidad (FUN), que la fiabilidad (FIA), la usabilidad (USAB), la mantenibilidad (MAB), los aspectos comunicacionales (ASPC), aspectos académicos (ASPA) y la portabilida (PQR).

En la Tabla 3, el valor de 1 indica que los dos aspectos comparados tienen la misma preferencia para los pares. Y los valores 1/3 y 1/2 corresponden a los inversos de los valores 3 y 2 respectivamente, es decir, que la comparación funciona en los dos sentidos.

Etapa 2. Normalización de las decisiones. Después de haber realizado las comparaciones de todos los criterios de la Tabla 3, las calificaciones otorgadas por los decisores se tratan matemáticamente como una matriz, para lo cual se suman cada uno de los valores de las columnas hasta obtener la sumatoria total y la desviación estándar para cada una.

Posteriormente, se normaliza la matriz de la Tabla 3, es decir, se divide cada término de cada una de las columnas de la Tabla 3 por el valor de la suma total de su respectiva columna reportada en la Tabla 4, y se obtiene otra matriz, tal como se presenta en la Tabla 5.

Etapa 3. Cálculo de los valores propios. Con la matriz de la Tabla 5, se calcula el vector de prioridad o auto vector de cada criterio, el cual es el promedio de la suma de las filas de los valores normalizados de cada uno de los criterios, dividido por el número de criterios en evaluación-l0 para este trabajo. Ver la columna de auto vector o peso relativo de cada criterio en evaluación en la Tabla 6. La suma de estos auto vectores debe ser igual a l.00, como lo propuso Saaty (1990, 1994) y se observa en la Tabla 6 (pág. 200).

Etapa 4. Priorización de los criterios. Consiste en ordenar los valores de los auto vectores acorde con el peso calculado de mayor a menor, es decir, los aspectos psicopedagógicos (ASPS)_leros, la eficiencia (EFI)_2da, la funcionalidad (FUN)_3era, los aspectos técnicos (ASPT)_4tos, la fiabilidad (FIA)_5ta, la mantenibilidad (MAB)_6ta, los aspectos comunicacionales (ASPC)_7mos, la usabilidad (USAB)_8va, los aspectos psicopedagógicos (ASPS)_9nos y la portabilidad (POR)_l0ma. Ver la columna de jerarquización de la Tabla 7.

Etapa 5. Cálculo del máximo valor propio o lambda máximo- Xmax. Saaty (2001, 2009) lo establece como el producto de la multiplicación de cada uno de los valores propios o autovectores de los criterios tomados de la Tabla 7 por el total de la suma de los valores de la columna de cada criterio procedentes de la Tabla 6, tal como se describe en la Tabla 8. El máximo valor propio es la suma de todos los máximos valores propios, calculados para cada criterio. Ver Tabla 8.

El máximo valor propio Àmax para este trabajo es de 10,785.

Etapa 6. Consistencia de las decisiones. El siguiente paso es determinar si los decisores han sido consistentes en sus evaluaciones. Entonces, siguiendo a Saaty (200l, 2009), con los valores de las Tablas 7 y 8, se calculan los indicadores con las ecuaciones de la Tabla 9.

En la Tabla 9, el resultado a resaltar es la razón de consistencia (RC), Saaty (2001) argumenta que cuando la razón de consistencia es inferior a 0.1, indica que los juicios están dentro de los límites recomendados, son consistentes y se debe continuar con el proceso.

Para este trabajo, la razón de consistencia (RC) fue de 0,05885 y, como es inferior a 0.1, continuamos con la etapa siguiente.

Etapa 7. Comparación de los laboratorios virtuales objeto de estudio. Finalmente, y dado que la razón de consistencia es inferior a 0.1, procedemos a comparar los laboratorios virtuales ante cada uno de los criterios, siguiendo el mismo proceso de las etapas l a 5 anteriormente descritas _matriz de los puntajes otorgados por los decisores, matriz de normalización, hasta llegar a la columna de priorización, jerarquización o importancia de los laboratorios virtuales acorde con los criterios en estudio, tal como se ilustra en la Tabla 10.

La clasificación relativa demuestra que el peso de los laboratorios virtuales (LVs) A, B y C son (0.35, 0.339 y 0.310 respectivamente), tal como se indica en la Figura l (pág. 202).

4. Discusión

La técnica de proceso analítico jerárquico (AHP) se adapta a situaciones muy diversas, su cálculo es sencillo, y consiste en la selección de alternativas, en función de una serie de variables o criterios. En este trabajo se siguieron las siguientes etapas: a) Definición del problema, b) Selección de decisiones, c) Identificación de las alternativas factibles, d) Construcción de los instrumentos para la evaluación, e) Tratamiento o análisis de los juicios, f) Síntesis de los resultados, g) Construcción del modelo jerárquico - toma de la decisión, y h) Validación de la decisión; ruta que valida la metodología propuesta por Saaty (200l, 2009) y Azadeh y Shirkouhi (2009) para el proceso analítico jerárquico (AHP) y la toma de decisiones.

El proceso seguido corrobora que el uso adecuado de las herramientas informáticas para simular y trabajar virtualmente un componente práctico requiere de una cuidadosa selección y ejercitación para garantizar su efectividad, como lo han propuesto varios investigadores (Bourne, Harris y Mayadas, 2005; Cataldi y colaboradores, 2012). El análisis realizado permitió visualizar y analizar la sensibilidad del resultado de la clasificación lograda, puesto que se ordenaron las alternativas de los laboratorios virtuales (LVs) respecto a la importancia de los criterios de comparación o variables de decisión, como lo proponen Alonso (2006), Azadeh y Shirkouhi (2009) y Cabala (20l0). Sin embargo, la técnica de análisis multicriterio (AHP), requiere una buena selección de los evaluadores o decisores quienes son los que definen los criterios y evalúan las alternativas, como lo proponen Davis y Williams (1994), Ozdemir (2005), Palcic y Lalic (2009) y Riaño y Palomino (s.f.).

Los diez criterios fueron clasificados jerárquicamente evidenciándose que el criterio de aspectos pedagógicos (ASPS) es más importante que el de eficiencia (EFI). Al mismo tiempo, este criterio es mucho más importante que la contribución del criterio de funcionalidad (FUNC) para seleccionar los laboratorios virtuales. Las decisiones que tomaron los expertos son perfectamente aceptables, puesto que la razón de consistencia fue de 0,05885 para el proceso, seguido, como lo recomiendan Saaty (2009), Ozdemir (2005) y Alonso (2006).

5. Conclusiones

Los diez criterios seleccionados dan un referente apropiado para evaluar y seleccionar laboratorios virtuales (LVs) puesto que el proceso seguido fue consistente y hace posible la toma de decisiones razonables para seleccionar laboratorios virtuales. Con el proceso analítico jerárquico (AHP) se pueden seleccionar objetivamente estos laboratorios, puesto que permite verificar la consistencia de cada uno de los criterios evaluados, y por ende, la consistencia de las respuestas de los expertos decisores. La ruta seguida es pertinente para evaluar y/o seleccionar los laboratorios virtuales.

El proceso analítico jerárquico (AHP) es una técnica y metodología que permite desarrollar y actualizar modelos de evaluación y de selección de laboratorios virtuales; puesto que permite depurar y clasificar aquellas especificaciones o criterios que pueden garantizar que el software que se va a utilizar cumple con los criterios necesarios para poder ser aplicado en un determinado contexto. 2021

El instrumento y el método de evaluación propuesto no está orientado a una lista de cotejo, sino que implican la reflexión del docente acerca del valor de ciertos criterios que se consideran importantes dentro de cada uno de los laboratorios virtuales, presentándose una evaluación más precisa y ajustada a la realidad.

El proceso analítico jerárquico (AHP) logra combinar todos los juicios de los expertos en varias matrices, en las cuales las alternativas de los laboratorios virtuales quedan organizadas desde la más hasta la menos indicada. La esencia del proceso analítico jerárquico (AHP) es la determinación de los pesos relativos para clasificar las alternativas de decisión. En este estudio, se ha identificado que mediante el uso del proceso analítico jerárquico (AHP) en los laboratorios virtuales tomados como modelos se pueden evaluar los atributos de estos de manera diferente, a partir de criterios de evaluación simples. Igualmente, el proceso analítico jerárquico (AHP) describe una decisión de compra efectiva, descubriendo los atributos eficaces de las diferentes alternativas de los laboratorios analizadas.

El cuestionario incluyó diez criterios pertinentes para la evaluación y clasificación, jerárquicamente, de laboratorios virtuales (LVs) con una razón de consistencia de 0,05885.

La mejor opción de laboratorios virtuales (LVs) es la A, puesto que es la que recibe la mayor puntuación total_35% (valor máximo próximo a 1), la opción B es la siguien-te_33.9% y la última, es la C_31% como lo han determinado para otros casos. Así, de los laboratorios virtuales en evaluación A es el de mayor peso, B es la opción siguiente y C es la menos apropiada para la actividad requerida. De esta forma es posible evaluar laboratorios, softwares multimedia o simuladores, con propuestas que siguen medidas y estándares de evaluación según las normas ISO/IEC 9126 (1991).

Agradecimientos

Los autores agradecen a la Universidad Nacional Abierta y a Distancia (UNAD), a los expertos docentes y a los estudiantes que de una forma u otra colaboraron para la realización de este trabajo; al profesor Marqués y al Grupo de Investigación Social - GIS.

Conflicto de intereses

Los autores declaran no tener ningún conflicto de intereses.

Referencias bibliográficas

1. ALANBAY, O. An enterprise resource planning (ERP) selection using expert choice software. In: ISAHP, 2005. Honolulu, Hawaii. [ Links ]

2. ALONSO, J. Consistency in the analytic hierarchy process: a new approach. In: International Journal for Uncertainty Fuzzines and Knolwledge-Based Systems, 2006, 14 (4), p. 445-459. [ Links ]

3. ALTSCHULD, J. Delphi technique. In: Lecture, Applied evaluation design. The Ohio State University. 2003. [Recuperado el 10 de julio de 2013] disponible en internet: http://link.springer.com/search?facet-author=%22A.+Azadeh%22. [ Links ]

4. AMERICAN EDUCATIONAL RESEARCH ASSOCIATION (AERA). Standards for Educational Psychological Test. In: American Psychological Association, Washington, D C, 1999. [ Links ]

5. AZADEH, A. y SHIRKOUHI, A. Evaluating simulation software using fuzzy analytical hierarchy process. In: Spring Sim 09 Proceedings of the Spring Simulation Multiconference, 2009. Article No. 41. [ Links ]

6. BELANGER, F. y JORDAN, D. Evaluation and Implementation of Distance Learning: technologies, tools and techniques. En: Idea Group Publishing, London. 2000. p. 246. [ Links ]

7. BOURNE, J., HARRIS, D. y MAYADAS, F. Online Engineering Education: Learning Anywhere, Anytime. In: Journal of Engineering Education, 2005, Vol. 94, p.131-146. [ Links ]

8. BRUNER, J. Toward a Theory of Instruction. Harvard University Press, Cambridge, MA, 1966. p. 192. [ Links ]

9. CABALA. P. Using the analytic hierarchy process in evaluating decision alternatives. In: Operations Research And Decisions, 2010.Vol. 1. [ Links ]

10. CABERO, J. Diseño y Evaluación de un Material Multimedia y Telemático para la Formación y Perfeccionamiento del Profesorado Universitario para la Utilización de las Nuevas Tecnologías Aplicadas a la Docencia. Universidad de Sevilla. España, 2002, p. 67- 95. [ Links ]

11. CATALDI, Z., DONNAMARÍA M. y LAGE, F. TICs en la enseñanza de la química: Laboratorios virtuales, modelos y simulaciones en cursos universitarios. En: Edutec, 15, 16 y 17 de septiembre, Manaos, 2009. [ Links ]

12. CATALDI, Z., CHIARENZA, D., DOMINIGHINI, C., DONNAMARÍA, L., y LAGE, F. TICs en la enseñanza de la química. En: Revista Iberoamericana de Educación en Tecnología y Tecnología en Educación, 2012, Vol. 3, no. 7. [ Links ]

13. COYA, A, ARRIETA X. y AULAR J. Revisión de modelos para evaluación de software educativos. En: Revista Electrónica de Estudios Telemáticos, 2008.Vol. 7, no. 1, p. 94 - 116. [ Links ]

14. DAVIS, L. y WILLIAMS, G. Evaluation and selecting simulation software using the analytic hierarchy process. In: Integrated Manufacturing Systems, 1994,.Vol. 51, no.1, p. 23-32. [ Links ]

15. DIAZ-ANTON, G. Uso de software educativo de calidad como herramientas de apoyo para el aprendizaje. En: Jornadas educativas: La escuela como instrumento de cambio, IEA, Abril, 2002. Caracas. [Recuperado el 11 de mayo de 2013] disponible en internet: http://www.academia-interactiva/articulos.html. [ Links ]

16. GALVIS, A. Ingeniería de software educativo. 1era ed. Sgda reimpresión. Universidad de los Andes, Bogotá, 2000. [ Links ]

17. GONZÁLEZ, J. y WAGENAAR, R. Tuning Educational Structures in Europe. En: Informe Final-Proyecto Piloto, Fase 1, 2003. Bilbao: Universidad de Deusto. [ Links ]

18. HERNÁNDEZ, R., FERNÁNDEZ, C. y BAPTISTA, P. Metodología de la investigación. 3th ed. Mc Graw Hill, México, 2006.p. 705. [ Links ]

19. HLUPIC, V. y MANN, A. A. System for Simulation Software Selection. In: Proc. of the 2002, Winter Simulation Conference, Orlando, Florida, p. 720-727. [ Links ]

20. ISO/IEC 9126. Information technology-Software Product Evaluation-Quality Characteristics and guidelines for their use. [Recuperado el 19 de julio de 2013] disponible en internet en: http://www.cse.dcu.ie/essiscope/sm2/9126ref.html. [ Links ]

21. JADHAY, A. y, SONAR, R. Evaluating and selecting software packages: A review. In: Information and Software Technology. 2009.Vol. 51, no 3, p. 555-563. [ Links ]

22. LANDETA, J. El método Delphi. Una técnica de previsión del futuro. Ariel, Barcelona, 2002.p. 223. [ Links ]

23. LAI, V., WONG, B. y CHEUNG, W. Group decision making in a multiple criteria environment: A case using the AHP in software selection. In: European Journal of Operational Research, 2002, Vol. 137, p. 134-144. [ Links ]

24. LÊ, Q. y LÊ, T. Evaluation of educational software: theory into practice. In: Technology and Teaching. Nova Science Publishers, 2007. 10 p. [ Links ]

25. MARQUÉS, P. Software educativo. Guía de uso y metodología de diseño. En: Editorial Estela, Barcelona, 1995. 256 p. [ Links ]

26. MARQUÉS, P. Plantilla para la Catalogación y Evaluación Multimedia. 2004 [Recuperado el 8 de septiembre de 2012] disponible en internet: http://dewey.uab.es/pmarques/evalua.htm. [ Links ]

27. MARQUÉS, P. Entorno formativo multimedia: elementos, plantilla de evaluación/criterios de calidad. 2005. [Recuperado el 8 de junio de 2010] disponible en internet: http://dewey.uab.es/pmarques/calidad.html. [ Links ]

28. MCDOUGAL, A y SQUIRES, D. Cómo elegir y utilizar software educativo. Ediciones Morata, Madrid, 2001. 176 p. [ Links ]

29. MENDOZA, L., PÉREZ, M. y GRIMÁN, A. Prototipo de Modelo Sistémico de Calidad (MOSCA) del Software. En: Computación y Sistemas, 2005, Vol. 8, no. 3, p. 196-217. [ Links ]

30. OSSADNIK, W. AND LANGE, O. AHP based evaluation of AHP software. In: European Journalof Operational Research, 1999, vol. 118, no. 3, p. 578-588. [ Links ]

31. OZDEMIR, M.Validity and inconsistency in the analytic hierarchy process. In: Applied Mathematics and Computation. 2005, vol.161, no. 3, p. 707-720. [ Links ]

32. Office of Technology Assessment (OTA). Power on! - New tools for teaching and Learning. In: Congress of the United States, Office of Technology Assessment, OTA SET-379, Whashington D.C. US Government Printing Office, 1988. [ Links ]

33. PALCIC. I. y LALIC. B. Analytical hierarchy process as a tool for selecting and evaluating projects. En: International journal simulations model. 2009, Vol. 8, no. 1, p. 16-26. [ Links ]

34. RADA, M. Instrumento de análisis y evaluación de software multimedia educativo. En: Revista educarnos, 2013. [Recuperado el 19 de julio de 2013] disponible en internet: http://www.revistaeducarnos.com/art%C3%ADculos/educaci%C3%B3n/iaesme-instrumento-de-an%-C3%Allisis-y-evaluaci%C3%B3n-de-software-multimedia-educati-vosl. [ Links ]

35. RAMOS, B., PELÁEZ, J., GARCÍA, E. y RUIZ, J. Design, Navigation, and Structure of a Hypermedia Application for the Teaching-Learning of Pneumatic Engineering Design Drawing. In: Computer Applications in Engineering Education, 2007, Vol. 15, p. 248-259. [ Links ]

36. RIAÑO y PALOMINO. Diseño y Elaboración de un Cuestionario Acorde con el Método Delphi, para Seleccionar Laboratorios Virtuales (Lvs). En: Revista de Investigación en Educación. (s.f. [ Links ]).

37. SAATY, T. The Analytic Network Process. In: Decision Making with the Analytic Network Process. Pittsburg University Press, 2001, p. 1-26. [ Links ]

38. SAATY, T. Extending the Measurement of Tangibles to Intangibles. In: International Journal of Information Technology & Decision Making, 2009, Vol. 8, no.1, pp.7-27. [ Links ]

39. SAMPIERI, COLLADO y BAPTISTA. Metodología de la Investigación. 5ta edición. In: McGraw-Hill, 2010. p. 704. [ Links ]

40. SHERMAN, T. y KURSHAN, B. Constructing Learning Using Technology to Support Teaching for Understanding. In: Learning & Leading with Technology, 2005, Vol. 32. no. 5, p.1-13. [ Links ]

41. VAIDYA, O. y KUMAR, S. Analytic hierarchy process: An overview of applications. In: European Journal of Operational Research, 2006, Vol. 169, p. 1-29. [ Links ]

42. VARGAS, L. An overview of the analytical hierarchy process and its application. In: European Journal of Operations Research, 1990, Vol. 48, No. 1, p. 2-8. [ Links ]

43. VERMA, R., GUPTA, A. y SINGH, K. Simulation Software Evaluation and Selection: A Comprehensive Framework. In: J. Automation & Systems Engineering, 2008, Vol. 2, p. 221-234. [ Links ]

44. VERMA, R., GUPTA, A. y SINGH, K. A critical evaluation and comparison of four manufacturing simulation softwares. In: Kathmandu University Journal Of Science, Engineering And Technology, 2008, Vol. 5, no. 1, p. 104- 120. [ Links ]